Palantir 为美军开发的 Maven Smart System 已在伊朗战场投入实战,AI 聊天机器人(包括 Anthropic 的 Claude)被嵌入从情报分析到打击方案生成的完整作战链。与此同时,Anthropic 因拒绝让五角大楼无条件使用 Claude 而被定性为”供应链风险”——一场关于 AI 军事化边界的博弈正在上演。本文基于 WIRED 深度报道、国防部演示及多方信源,全面解析这一事件。

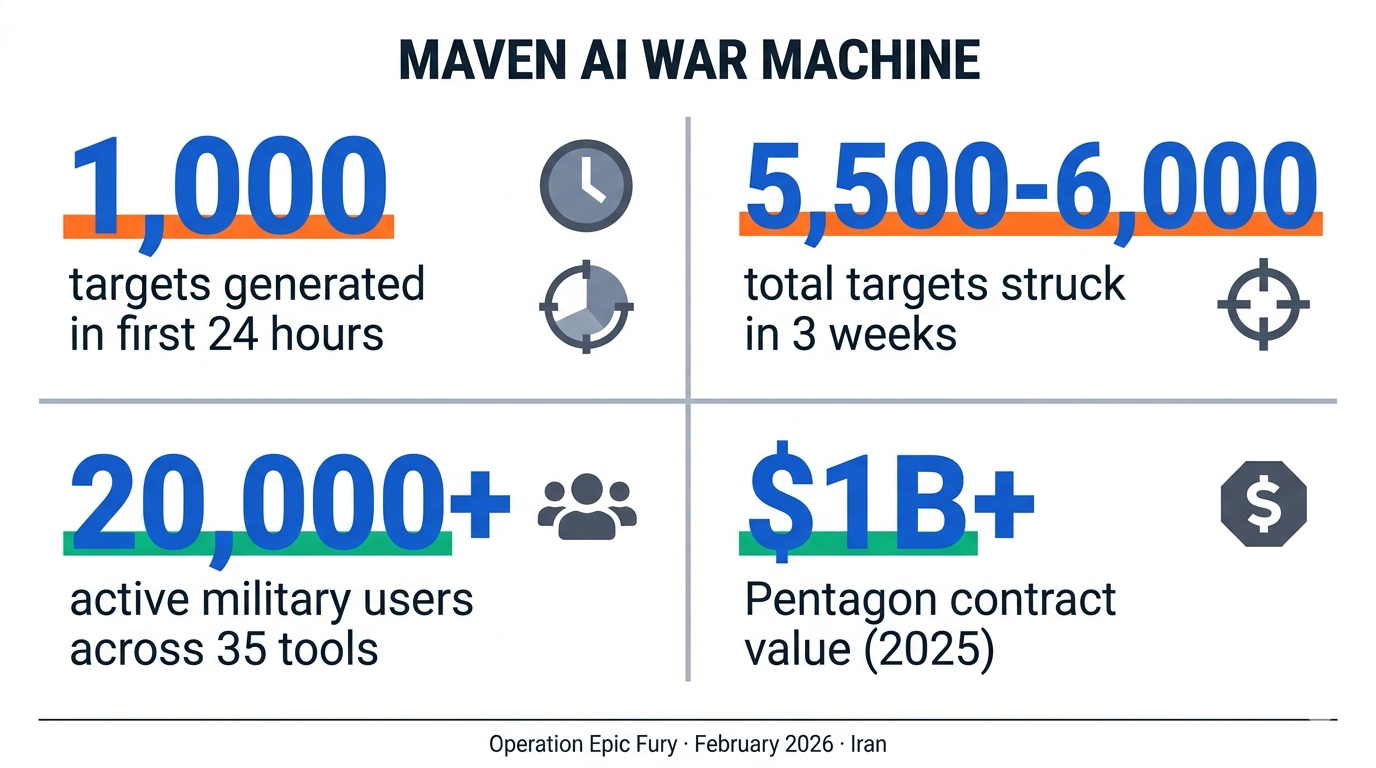

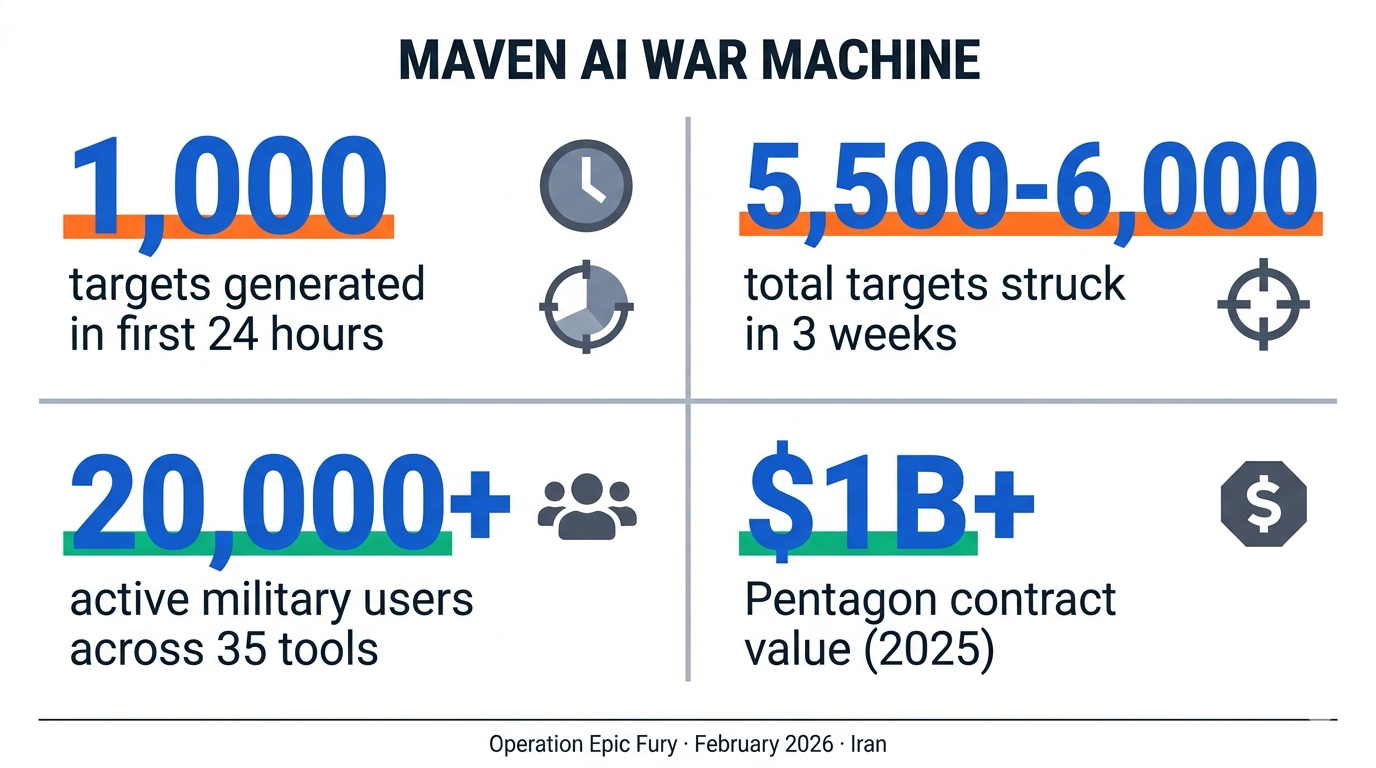

2026 年 2 月 28 日,美军对伊朗发动”史诗之怒行动”(Operation Epic Fury)。在头 24 小时内,一套名为 Maven 的 AI 系统帮助生成了约 1,000 个打击目标——这个数字在过去可能需要情报分析师花费数周才能完成。三周后,打击目标总数达到 5,500 至 6,000 个(据 NBC News 和 Bloomberg 报道)。

这套系统背后的公司是 Palantir,驱动它”思考”的 AI 引擎来自 Anthropic 的 Claude。而就在 Maven 于战场密集运转的同时,Anthropic 却因拒绝让五角大楼无条件使用 Claude 而被定性为”供应链风险”,一边在用它的技术打仗,一边试图封杀它。

Maven 现在能做什么

Maven Smart System 目前拥有超过 20,000 名活跃用户,横跨 35 个军事服务和作战司令部工具,在三个安全分级域上运行。陆军、空军、太空军、海军、海军陆战队以及负责中东军事行动的美国中央司令部都可以使用它。2025 年 5 月,国防部将 Palantir 的 Maven 合同总额提升至超过 10 亿美元(据 DefenseScoop 报道)。

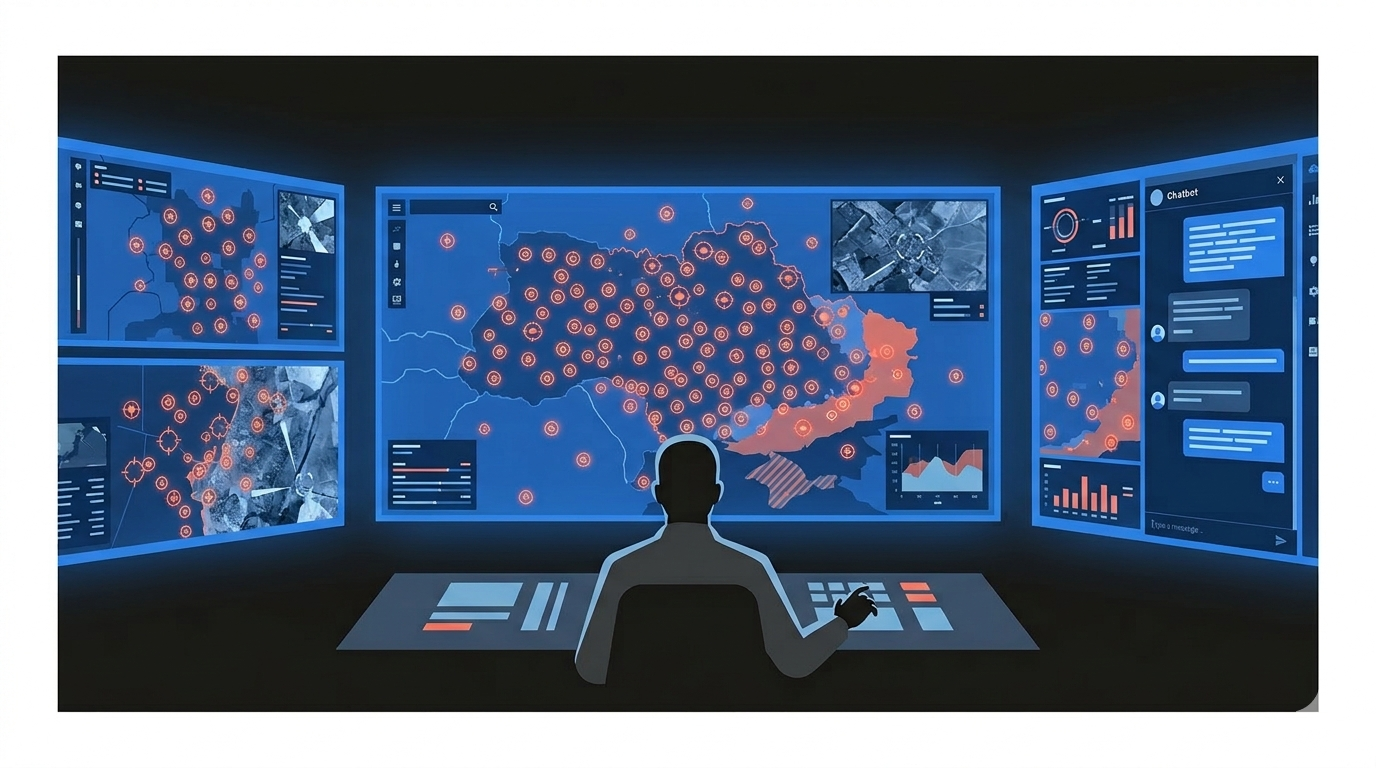

美国国防部首席 AI 官 Cameron Stanley 在 2026 年 3 月的 Palantir 大会上演示了 Maven 的四大核心能力:

计算机视觉——对卫星图像自动应用视觉算法,检测地面目标。系统能区分人员和车辆,自动标记可能的”敌方系统”。

目标可视化与提名——不仅能发现目标,还能将潜在目标”提名”为地面或空中打击对象。

AI 资产任务推荐器(AI Asset Tasking Recommender)——系统能自动建议应该派出哪种轰炸机、使用何种弹药来打击特定目标。

情报分发——在军事官员之间传递目标情报数据和敌情报告。

而让 Maven 真正引发广泛争议的,是 AI 聊天机器人被嵌入了整个作战决策链。

AI 聊天机器人如何参与作战规划

2024 年 11 月,Palantir 宣布将 Anthropic 的 Claude 模型集成到面向美国情报和国防机构的软件中。Claude 通过 Palantir 的 AIP(Artificial Intelligence Platform,人工智能平台)嵌入现有产品——AIP 不是一个独立产品,而是在 Foundry 或 Gotham 等平台内部运行的应用层,为用户提供一个”AIP 助手”聊天机器人。

据 WIRED 报道,AIP 助手支持多种大语言模型——Anthropic 的 Claude、OpenAI 的 GPT-4.1、Meta 的 Llama——用户可以自主选择模型,以及模型可以访问哪些数据。这在情报和国家安全领域尤为关键,因为很多数据是机密的。

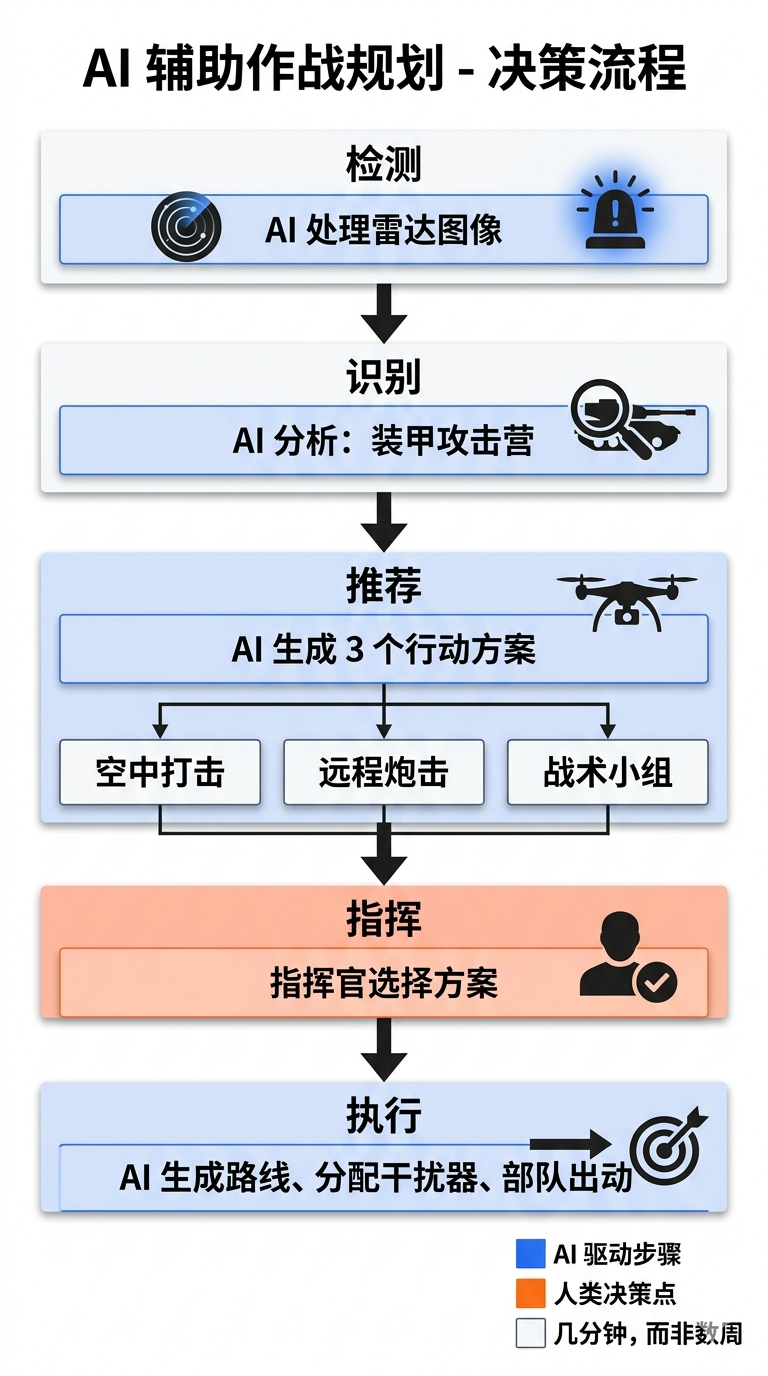

Palantir 在 2023 年发布的一段演示展示了一个完整的作战规划流程:

- AIP 助手通过雷达图像的 AI 处理发出自动警报——“检测到潜在异常敌方活动”

- 分析师询问:“该区域有什么敌方军事单位?”

- 助手回答:“根据装备模式判断,可能是一个装甲攻击营”

- 分析师请求 MQ-9 “死神”无人机前去侦察

- 分析师要求助手”生成三个针对该敌方装备的行动方案”

- 助手在几秒内给出三个选项:空中打击、远程炮击、战术小组

- 方案发送给指挥官,指挥官选择战术小组

- 分析师继续要求助手”分析战场”、“生成行军路线”、“分配干扰器”

- 最终审核后,下令部队出动

整个过程从发现目标到下达作战命令,仅用了几分钟。

在 NATO 使用 Maven 的场景中,Palantir 展示了一个 COA(Courses of Action,行动方案)面板,AI 模型能一次生成五种可能的军事策略,其中一个方案名为”火力掩护-渗透-突击-歼灭”(Support-by-Fire-Then-Penetration-Shock-and-Destruction)。

情报分析中的应用

2025 年 6 月,Anthropic 公共部门负责人 Kunaal Sharma 演示了 Claude 如何生成关于乌克兰无人机行动”蜘蛛网行动”(Operation Spider’s Web)的情报报告。

Sharma 说:“这通常是我花五个小时、喝着咖啡、查 Google、翻智库报告才能写出来的东西。但我没那么多时间。”

他让 Claude 创建交互式仪表板,将信息转化为可在 Palantir Foundry 中分析的对象类型,还要求 Claude 撰写了一份关于俄罗斯边境省份最新局势的详细分析。据 WIRED 报道,Claude 在 2025 年 1 月美国军方逮捕委内瑞拉总统马杜罗的行动中也发挥了关键作用。

伊朗战争:AI 作战的实战检验

“史诗之怒行动”是 Maven 的第一次大规模实战检验。据多家媒体报道,Maven/Claude 将原本需要数天乃至数周的作战规划压缩到了几分钟之内。打击目标涵盖无人机和弹道导弹基地、指挥控制设施、舰船、防空系统和军事通信设施。

但 AI 加速带来的后果也触目惊心。在一次空袭中,一所伊朗女子学校被击中,造成至少 175 人死亡,其中大多数是儿童(据 Common Dreams 报道)。120 多名美国众议院民主党议员随后要求调查:AI 是否参与了这次空袭的目标选择决策?这一事件将”AI 辅助目标选择”的伦理争议推到了所有人面前。

这段演示视频在 X 上也引发了两极反应——超过 180 万次观看,有人将 Maven 比作”国防版 Trello”,也有人指着学校空袭的新闻痛斥技术的滥用。

Anthropic 与五角大楼的正面冲突

在 Maven 于伊朗战场密集运转的同时,它的核心 AI 供应商却与五角大楼走向了决裂。

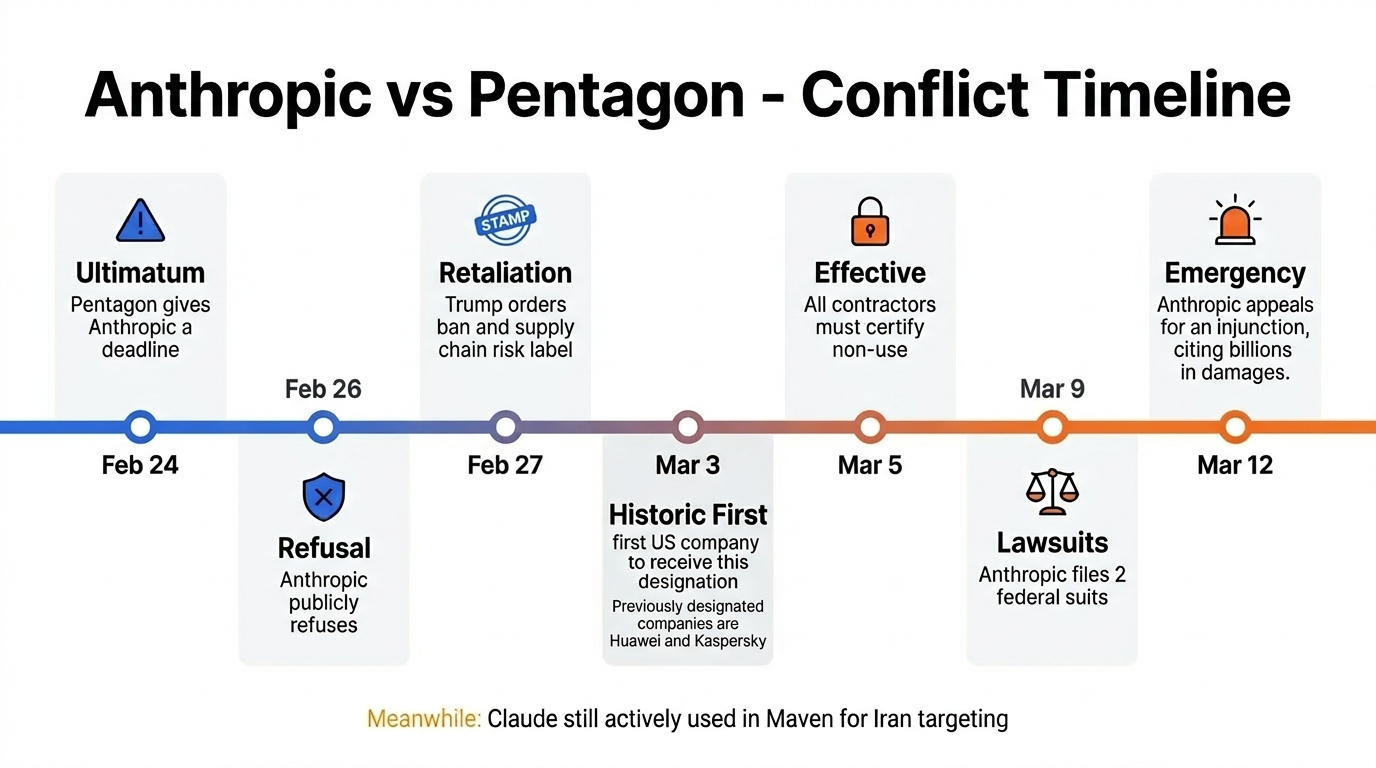

以下是这场冲突的详细时间线:

| 日期 | 事件 |

|---|---|

| 2026-02-24 | 国防部长 Pete Hegseth 向 Anthropic CEO Dario Amodei 下最后通牒:2 月 27 日下午 5:01 前允许 Claude 被”用于所有合法目的” |

| 2026-02-26 | Anthropic 公开拒绝让步 |

| 2026-02-27 | 特朗普指示联邦机构停止使用 Anthropic 产品;Hegseth 将其定性为”供应链风险” |

| 2026-03-03 | 正式通知函发出——美国历史上首次对本国公司使用该定性(此前仅用于华为、卡巴斯基等外国企业) |

| 2026-03-05 | 定性正式生效,所有军事承包商须证明未使用 Anthropic 模型,国防机构有六个月过渡期 |

| 2026-03-09 | Anthropic 提起两项联邦诉讼(加州:宪法第一修正案;华盛顿特区:行政程序法) |

| 2026-03-12 | Anthropic 向上诉法院申请紧急禁令,称将造成”数亿至数十亿美元的不可挽回损失” |

Anthropic 坚守的两条红线很明确:

- Claude 不得用于大规模监控美国公民

- Claude 不得驱动全自主武器系统(必须保留人类决策环节)

这场争端在硅谷引发了连锁反应。一些公司因 Anthropic 被标记为”供应链风险”而暂停了商业谈判。OpenAI 和 Google DeepMind 的员工站了出来——包括 DeepMind 首席科学家 Jeff Dean——联合提交了支持 Anthropic 的”法庭之友”简报,警告称惩罚一家领先的美国 AI 公司将损害美国的工业和科学竞争力。

最荒诞的是:就在”供应链风险”定性正式生效的同一时期,Claude 仍在 Maven 系统中被用于伊朗战场的目标生成。五角大楼一边试图封杀 Anthropic,一边还在依赖它的技术打仗。

Maven 的前世今生

Maven 的故事要追溯到 2017 年。

当年 4 月,时任美国国防部副部长 Robert O. Work 签署备忘录,正式成立了”算法战跨职能小组”(Algorithmic Warfare Cross-Functional Team),即后来的 Project Maven。成立的核心动因是:美国在防务 AI 领域正被中国赶超。国防部每年要处理数百万小时的无人机视频和卫星图像,远超人工分析能力。Maven 的目标是用机器学习来自动检测、分类和追踪图像中的目标——车辆、人员、建筑。

早期项目预算约 7000 万美元,Google 是关键承包商,提供 TensorFlow 框架来构建计算机视觉算法。但 2018 年,Google 员工发现公司在为军事项目提供技术支持后,数千人签署请愿书抗议,多人辞职。Google 最终选择不续签合同。

此后,Palantir、Anduril 等公司接手了 Maven 的开发,项目规模迅速扩大。到 2025 年,Maven 已从图像分析工具进化为综合性战场 AI 平台,并扩展到 NATO 成员国。

有意思的是,历史似乎在重演。2018 年 Google 因员工抗议退出 Maven,2026 年 Anthropic 因坚守伦理红线被五角大楼驱逐。不同的是,Google 是主动离开,Anthropic 是被赶走——而且 OpenAI 已经取消了此前的军事用途禁令,似乎更愿意配合五角大楼的需求。

科技与伦理的十字路口

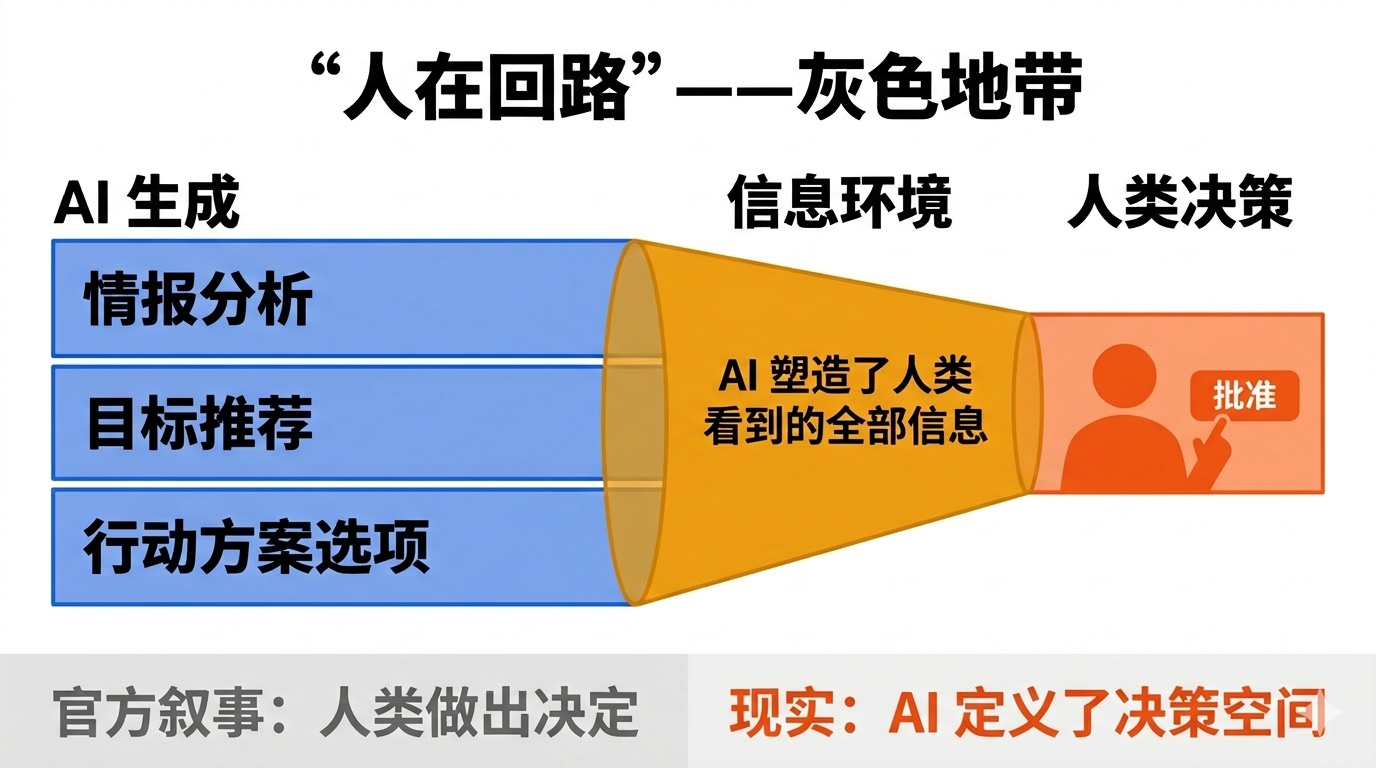

当 AI 能在几秒内生成作战方案并推荐打击目标时,“人在回路”(human-in-the-loop)的保障还有多少实际意义?分析师在面对 AI 已经给出的”专业建议”时,真的能保持独立判断吗?

AIP 助手不是直接”建议目标”,而是通过帮助分析师”采取行动”来间接参与目标确定。这种设计在法律和伦理上创造了一个微妙的灰色地带——AI 没有”做决定”,但它塑造了做决定的全部信息环境。

对我国而言,这场博弈的意义不仅在于围观。Maven 的发展轨迹表明,AI 军事化已不是”是否会发生”的问题,而是”以何种形式、在何种约束下发生”的问题。当美国内部还在争论 AI 公司应该为军方做多少的时候,全球范围内的军事 AI 竞赛早已悄然加速。关注这场博弈中”红线”如何被划定、又如何被突破,可能比关注任何一款武器系统本身都更重要。

参考来源

- Bilawal Sidhu 推文(X):Palantir Maven Smart System 演示视频,180 万+ 观看

- WIRED:《Palantir Demos Show How the Military Could Use AI Chatbots to Generate War Plans》,Caroline Haskins,2026-03-13

- NBC News、Bloomberg:Operation Epic Fury 中 AI 辅助目标生成数据

- DefenseScoop:Maven 合同总额提升至 10 亿美元以上(2025-05)

- Common Dreams:伊朗女子学校空袭事件及国会议员调查要求

- Axios、CNN、CNBC:Anthropic 与五角大楼”供应链风险”争端时间线