****

在当今机器学习领域,大规模数据集对解决复杂问题起着至关重要的作用。例如,用于训练大型语言模型的 FineWeb 数据集就达到了44TB 的规模。然而,在科学数据领域,特别是物理数值模拟方面,数据的收集、过滤和解释都面临着独特的挑战。为了解决这一问题,研究人员推出了一个名为 “The Well” 的数据集。

与自然数据集不同,科学数据的收集和解释都极其困难。例如,评估一个湍流天体物理过程的合理性,与判断一张猫咪照片的质量有着本质的区别。这需要深厚的专业知识和丰富的领域经验。正是认识到这一挑战,The Well 项目致力于将复杂的科学数据集标准化,使机器学习研究者能够专注于最重要的任务:预测物理现象。

The Well 数据集概述

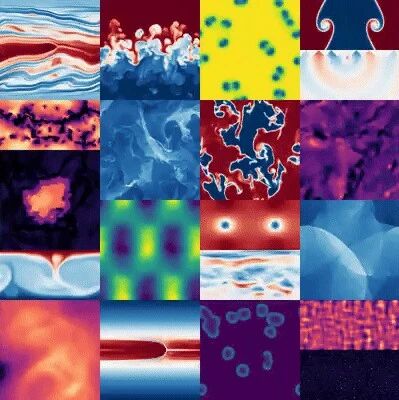

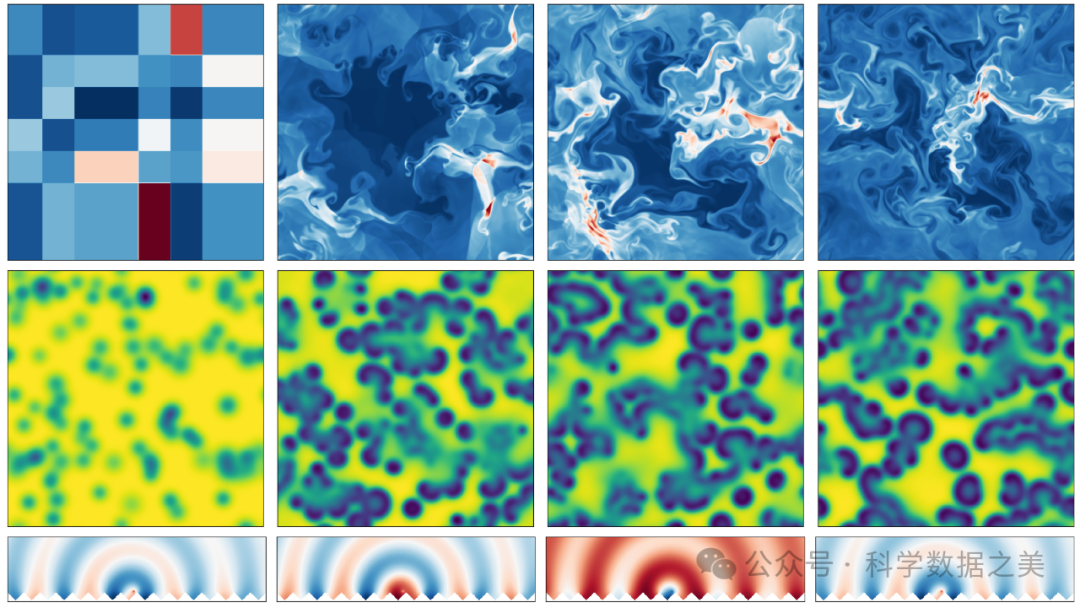

The Well 是一个大规模机器学习数据集合,包含了各种时空物理系统的数值模拟。该项目汇集了来自领域科学家和数值软件开发者的贡献。数据集包含 16 个子数据集,数据总量超过 15TB,单个子数据集的大小从 6.9GB 到 5.1TB 不等。数据集涵盖了广泛的领域,包括:

- 生物系统

- 流体动力学

- 声学散射

- 河外流体的磁流体动力学模拟

- 超新星爆发模拟

研究者可以单独使用这些数据集,也可以将其作为更广泛的基准测试套件的一部分,用于加速机器学习和计算科学领域的研究。该数据集具有以下特点:

-

标准化格式:所有数据都在统一的空间网格上采样,具有恒定的时间间隔,并以 HDF5 格式存储,确保了简单性、可访问性和与科学工作流程的兼容性。

-

易用性:提供了 PyTorch 接口,可以无缝集成到机器学习模型中。

-

专业性:与领域专家密切合作生成和策划数据集,确保数据的质量和科学价值。

The Well 为机器学习研究者提供了独特的研究机会:

- 创新的基准测试:

- 空间-时间模式与自然视频有本质区别

- 提供了全新的评估标准和挑战

- 丰富的知识迁移任务:

- 跨物理参数的泛化能力研究

- 不同分辨率之间的知识迁移

- 多尺度物理现象的建模

- 时间变化处理:

- 处理不同时间间隔的数据采样

- 保持预测的时间连续性和物理一致性

- 物理参数泛化:

- 探索模型在未见参数空间的表现

- 研究物理规律的隐式学习能力

数据集下载、工具安装与使用

项目提供处理和使用该数据集的 python 工具包,可以通过 pip 安装该工具包。

pip install the_well

或者直接从源码安装:

git clone https://github.com/PolymathicAI/the_well

cd the_well

pip install .

如果在GPU硬件环境安装,可以通过指定参数—extra-index-url

pip install . —extra-index-url https://download.pytorch.org/whl/cu121

安装benchmark:

pip install the_well[benchmark]

python工具包安装完成后,可以使用以下命令来下载需要的数据集:

the-well-download —base-path path/to/base —dataset active_matter —split train

也可以直接访问存储在HugginFace上的数据集:

1from the_well.data import WellDataset

2from torch.utils.data import DataLoader

3

4# The following line may take a couple of minutes to instantiate the datamodule

5trainset = WellDataset(

6 well_base_path=“hf://datasets/polymathic-ai/”, # access from HF hub

7 well_dataset_name=“active_matter”,

8 well_split_name=“train”,

9)

10train_loader = DataLoader(trainset)

11

12for batch in train_loader:

13 …

References:

本公众号相关内容推荐

- 推荐6个美化Matplotlib可视化样式的python库

- AI天气模型的现状与未来

- 流式传输和渲染可视化三维地理空间数据

- GIS领域常用的24种数据格式

- 一种基于图神经网络的三维建筑模型重建方法

- WebGIS技术栈推荐

- 使用Python工具可视化大型图网络

- 使用NetworkX提取图网络特征

- Argo海洋观测数据处理分析python库:ArgoPy

- 在Jupyter环境中创建交互式可视化地图

- 处理和可视化地理空间数据的Python库:EarthPy

- 地理空间深度学习python库:TorchGeo

- 遥感数据分析python库scikit-eo

- 图网络的应用场景及图分析python库

- 使用Python和NetworkX创建并可视化图网络(Graph Network)

- OpenResearcher:一个开源科学研究AI助理

- NeuralGCM: 一种融合机器学习与物理原理来模拟地球大气的新方法

- Transformer Explainer:文本生成模型交互式可视化工具

- 用于探索性数据分析(EDA)的开源python库

- 分享一个构建交互式D3js可视化的Python库

- 推荐15个图网络可视化python软件包

- 9个提升科研效率的软件工具

- 生成式人工智能模型颠覆传统天气预报

- 分享5个python可视化图表工具

- 分享17个网络(Network)数据可视化工具