AI 的下一波浪潮将在物理世界中行动

我们正处于AI发展的一个关键转折点。大语言模型在文本和图像领域已经取得了惊人的成就,但AI的下一个前沿是在真实的物理世界中行动,例如抓取物体、打开冰箱、在房间之间导航。这就是具身智能(Embodied AI)研究的核心目标。

然而,训练一个能够在真实世界中泛化的机器人,面临着一个基本矛盾:你需要海量的数据来训练,但在真实世界中采集数据既昂贵又缓慢。这就是仿真平台存在的意义,但过去的仿真环境往往物理引擎过于简化,资产规模有限,与真实世界差距太大。

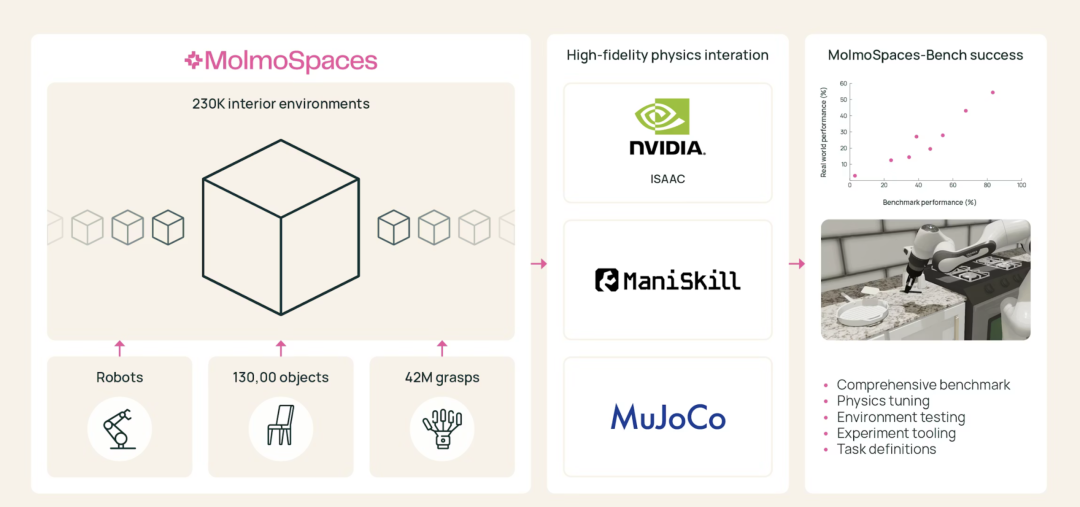

2025 年 2 月,Allen AI(Ai2)发布了 MolmoSpaces,一个将物理仿真、大规模场景库、精细抓取标注三者统一的开放生态系统,目标是为具身智能研究提供一个真正可用的基础设施。

一、MolmoSpaces 的核心组件

MolmoSpaces 不是一个单一工具,而是一个由多个组件构成的完整生态。

1.1 大规模场景库:23 万+ 室内环境

MolmoSpaces 汇聚了超过 23 万个室内场景,涵盖住宅、办公室、教室、医院、学校、博物馆等多种类型。这些场景来自四个不同的来源:

| 来源 | 规模 | 生成方式 |

|---|---|---|

| iTHOR-120 | 120 个场景 | 手工精心制作 |

| ProcTHOR-10K | 1 万个场景 | 启发式程序化生成 |

| ProcTHOR-Objaverse | 大规模场景 | 基于 Objaverse 资产的程序化生成 |

| Holodeck | 大规模场景 | LLM 辅助的程序化生成 |

关键质量指标:超过 95% 的场景通过了碰撞检测和物体漂移验证测试,确保场景在物理仿真中是稳定可用的。

1.2 海量物体资产:13 万+ 3D 模型

物体资产是机器人操作研究的核心。MolmoSpaces提供了超过 13 万个物体模型,全部以MJCF和USD格式提供:

来自THOR的资产:

- • 1,600+ 个刚体可抓取物体实例,覆盖 134 个类别

- • 这些是经过精心建模的高质量资产

来自 Objaverse 的资产:

- • 从 62.5 万个候选资产中筛选出 12.9 万个高质量资产

- • 覆盖约 3,000 个 WordNet 同义词集(synsets)

- • 约 9.2 万个资产适合自动化场景填充

筛选标准极为严格,包括:

- • 元数据完整性:确保每个资产都有充分的描述信息

- • 尺度归一化:统一物体的物理尺度

- • 纹理质量评分 ≥ 4:保证视觉保真度

- • 跨渲染器保真度(CLIP 相似度 ≥ 0.6):确保在不同渲染器中表现一致

- • 几何体积效率(< 1.5 MB):控制计算开销

- • 容器验证:确保作为容器使用的物体功能正确

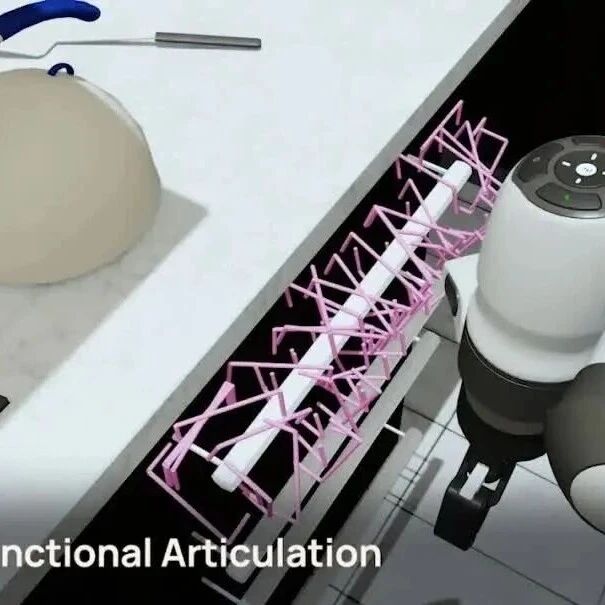

铰接物体(如冰箱、微波炉、烤箱、洗碗机、门、抽屉柜)则带有显式的关节标注,包含铰链/滑轨类型、轴向、位置和运动范围。

1.3 物理验证:告别”魔法抓取”

这是 MolmoSpaces 最核心的技术亮点。过去的仿真平台常常使用简化的物理模型甚至”魔法抓取”(magic grasps),即机器人不需要真正地接触和握住物体,只要靠近就自动吸附。这种做法让仿真到真实世界的迁移(sim-to-real transfer)变得极其困难。

MolmoSpaces 采用 MuJoCo 等物理引擎,并对物理参数进行了严格验证:

刚体物理验证:

- • 通过将仿真中的质量和密度值与 LLM 标注的估计值进行对比

- • 迭代调整密度参数直到匹配

铰接物体验证:

- • 使用遥操作套件控制仿真中的 Franka FR3 机械臂

- • 通过真实的推方块、抓取已知重量物体的轨迹来优化关节属性

- • Franka FR3 机械臂本身也经过了系统辨识(System Identification)验证

碰撞体准备:

- • 使用 CoACD 算法生成碰撞体网格

- • 为所有资产标注了基元碰撞体(primitive colliders)

- • 以容器为主的刚体(桌子、柜子等)使用基元碰撞体以避免 mesh-mesh 接触问题

- • 可操作物体使用凸分解(convex decomposition)以获得更高的几何保真度

1.4 抓取标注:4200 万+ 精细抓取位姿

MolmoSpaces 包含超过 4200 万个 6-DoF 抓取位姿,覆盖 48,111 个物体(每个物体最多约 1,000 个抓取位姿),使用 Robotiq-2F85夹爪模型。

抓取标注的生成流程值得关注:

- 1. 采样:直接从 MJCF 几何体上采样;对于铰接物体,限制在叶节点组件(通常是把手)上采样

- 2. 碰撞过滤:与非叶节点几何体碰撞的抓取被丢弃

- 3. 聚类选择:在完整的 6-DoF 位姿空间中进行聚类,然后在聚类间均匀选择,确保抓取多样性

- 4. 接触偏好:针对不同物体指定接触点偏好(例如指垫中部 vs. 薄物体使用指尖)

- 5. 稳定性测试:刚体抓取需通过线性和旋转扰动测试

- 6. 铰接物体可行性验证:要求在保持接触的同时,能够稳定地驱动关节至少 70% 的有效运动范围(双向)

二、MolmoSpaces-Bench:多维度评估框架

传统的机器人操作评估通常只报告一个汇总的成功率数字,这掩盖了系统在不同条件下表现差异的细节。MolmoSpaces-Bench 提出了一种多维度系统性评估方法,沿以下独立轴进行变化:

| 评估维度 | 说明 |

|---|---|

| 物体属性 | 形状、尺寸、重量、铰接方式 |

| 布局 | 多房间、多楼层、不同杂乱程度 |

| 任务复杂度 | 从单步操作到层次化任务 |

| 感知条件 | 光照变化、视角差异 |

| 动力学 | 摩擦系数、质量变化 |

| 任务语义 | 指令措辞的变化 |

支持的任务类型包括:

- • 原子操作技能:抓取(pick)、放置(place)、打开(open)、关闭(close)

- • 组合任务:原子技能的组合

- • 导航目标:显式的导航任务

这种评估框架能够实现:

- • 受控实验的分布分析

- • 分布外(OOD)失败模式的识别

- • 训练多样性对 sim-to-real 迁移的影响测量

- • 系统性的真实世界验证支持

三、平台兼容性与数据采集

多仿真器支持

MolmoSpaces 的资产以 MJCF 和 USD 两种格式提供,显式支持以下仿真平台:

- • MuJoCo —— 原生 MJCF 支持

- • ManiSkill —— 直接兼容

- • NVIDIA Isaac Lab/Sim —— 通过 USD 转换脚本支持

遥操作数据采集

平台支持使用 Teledex 等移动设备进行遥操作数据采集。研究者可以直接通过手机收集操作演示数据,无需复杂的硬件配置。同时兼容 DROID 和 CAP 等已有的具身方案。

四、最后

MolmoSpaces 的发布标志着具身智能研究基础设施的一次重大升级:

- 1. 规模前所未有:23万场景 + 13万物体 + 4200万抓取标注,这是目前已知最大规模的具身智能仿真生态

- 2. 物理真实性:告别简化物理和魔法抓取,每个物理参数都经过验证

- 3. 完全开放:代码、数据、演示全部开源,降低研究门槛

- 4. 评估标准化:MolmoSpaces-Bench 为社区提供了一个共同的、多维度的评估框架

从Ai2-THOR到MolmoSpaces,Allen AI团队延续了他们在开放仿真领域的一贯传统。Ai2-THOR系列已经证明了开放仿真平台如何加速机器人导航研究,而 MolmoSpaces将这一理念扩展到了机器人操作领域,并在物理保真度和资产规模上实现了质的飞跃。