随着人工智能和机器学习的快速发展,像Meta的LLaMA 3和OpenAI的ChatGPT这样的大语言模型(LLMs)在各种应用场景中变得越来越受欢迎。然而,运行大语言模型通常需要将数据发送到由OpenAI或者其他AI模型提供商管理的服务器。尽管这些服务是安全的,但一些用户更倾向于将数据完全离线,以确保更高的隐私性。

运行本地大语言模型可以帮助用户深入了解其性能和工作原理。本地大语言模型能够与私有文档和技术论文进行交互,从而确保这些文档的信息不会上传至任何云端AI服务器。本地大语言模型在无互联网的地方以及网络信号较差的地区非常有用。

本文推荐6个支持在本地运行和测试LLMs的软件工具。这些工具在用户使用时不会收集用户数据或跟踪用户行为。它允许所有聊天数据保留在本地计算机上,而不会与AI/ML服务器共享。

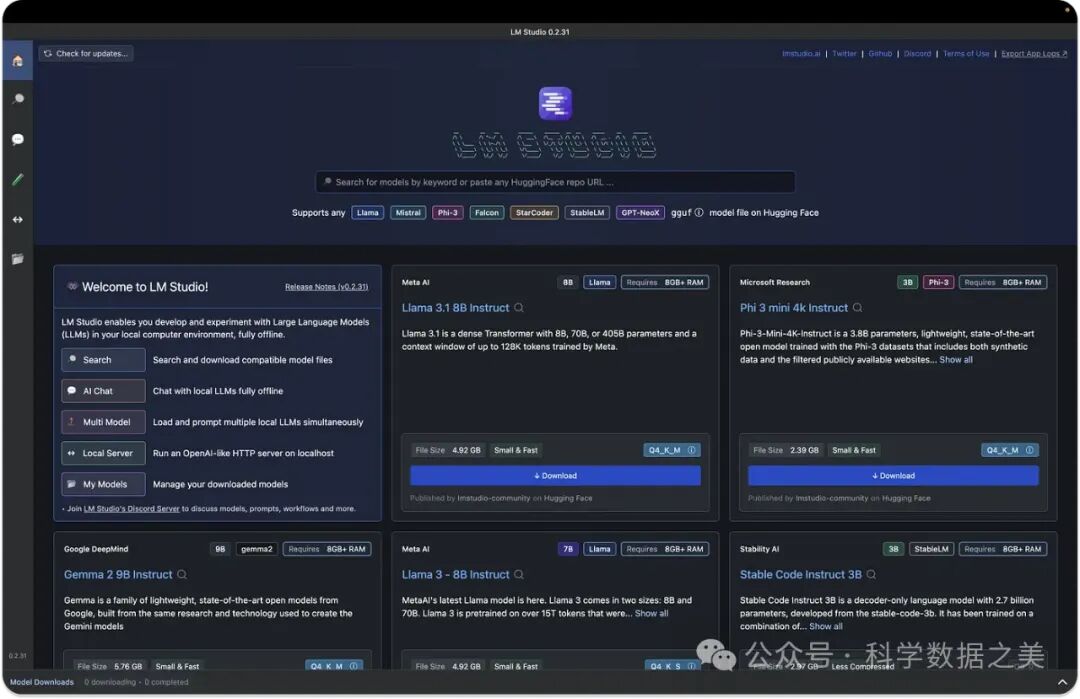

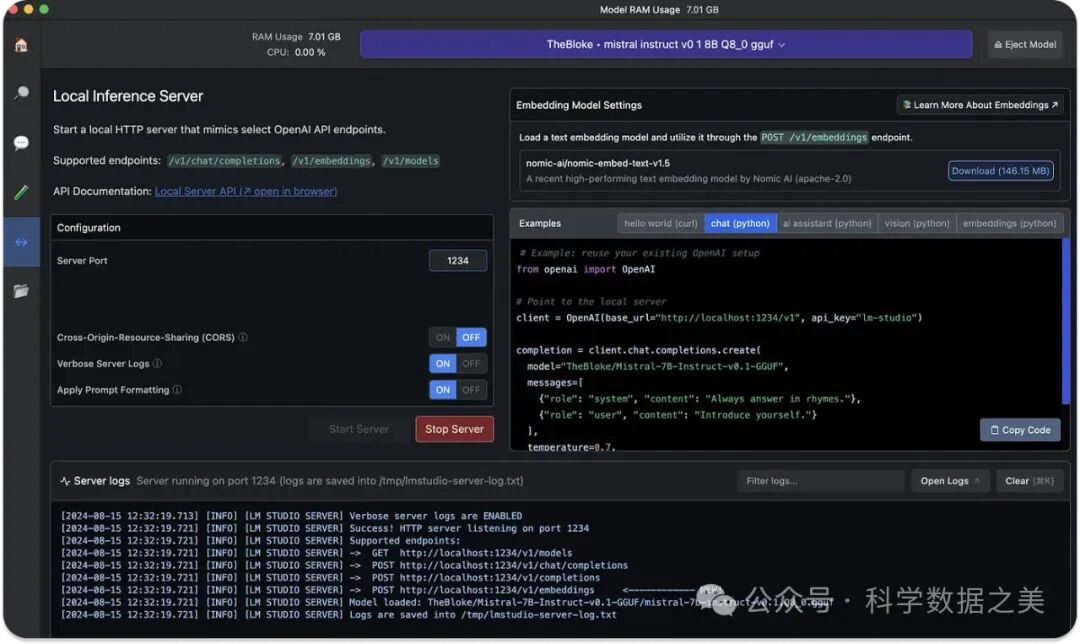

- LM Studio

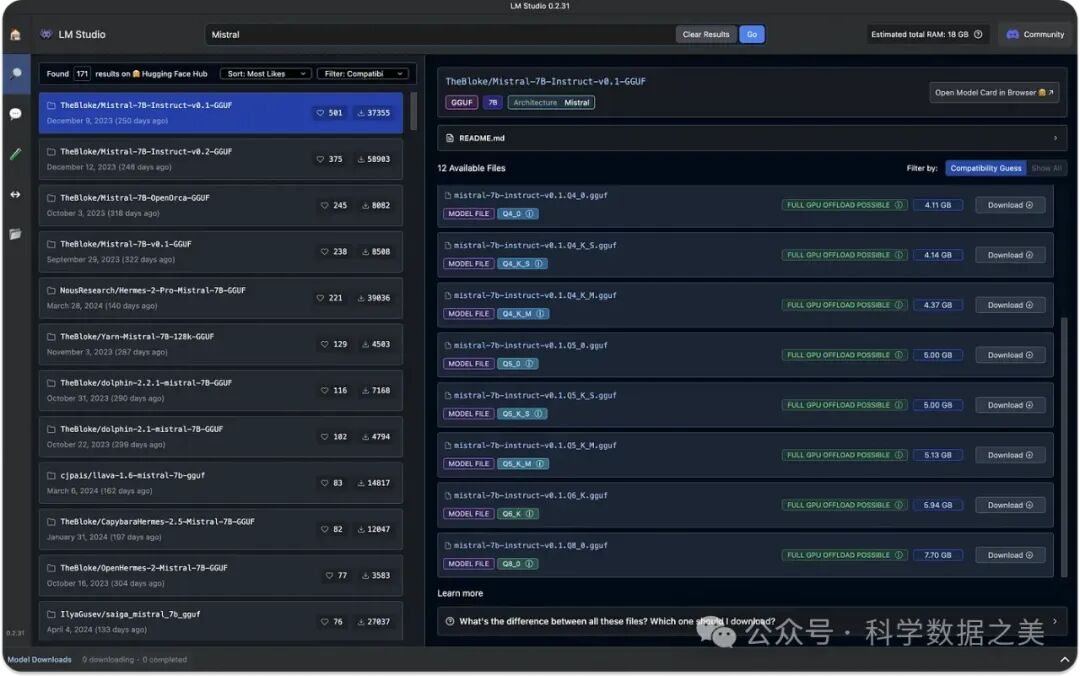

LM Studio提供与ChatGPT类似的功能和特性,可以运行任何格式为gguf的模型文件,如Llama 3.1、Phi 3、Mistral和Gemma。启动LM Studio后,页面上会展示可下载和测试的大语言模型。还可以使用搜索框过滤并从不同的AI提供商下载特定模型。

下载地址:https://lmstudio.ai

使用下面的示例Python代码,用户可以重用现有的OpenAI配置,并修改基本URL以指向您的本地主机。

1from openai import OpenAI

2

3# Point to the local server

4client = OpenAI(base_url=“http://localhost:1234/v1”, api_key=“lm-studio”)

5

6completion = client.chat.completions.create(

7 model=“TheBloke/Mistral-7B-Instruct-v0.1-GGUF”,

8 messages=[

9 {“role”: “system”, “content”: “Always answer in rhymes.”},

10 {“role”: “user”, “content”: “Introduce yourself.”}

11 ],

12 temperature=0.7,

13)

14

15print(completion.choices[0].message)

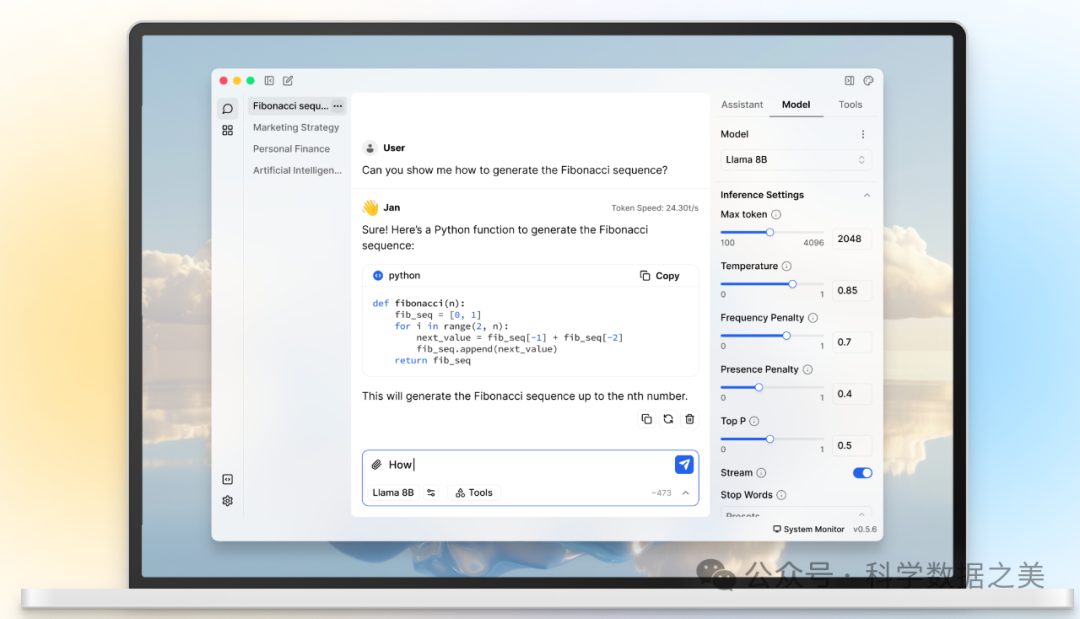

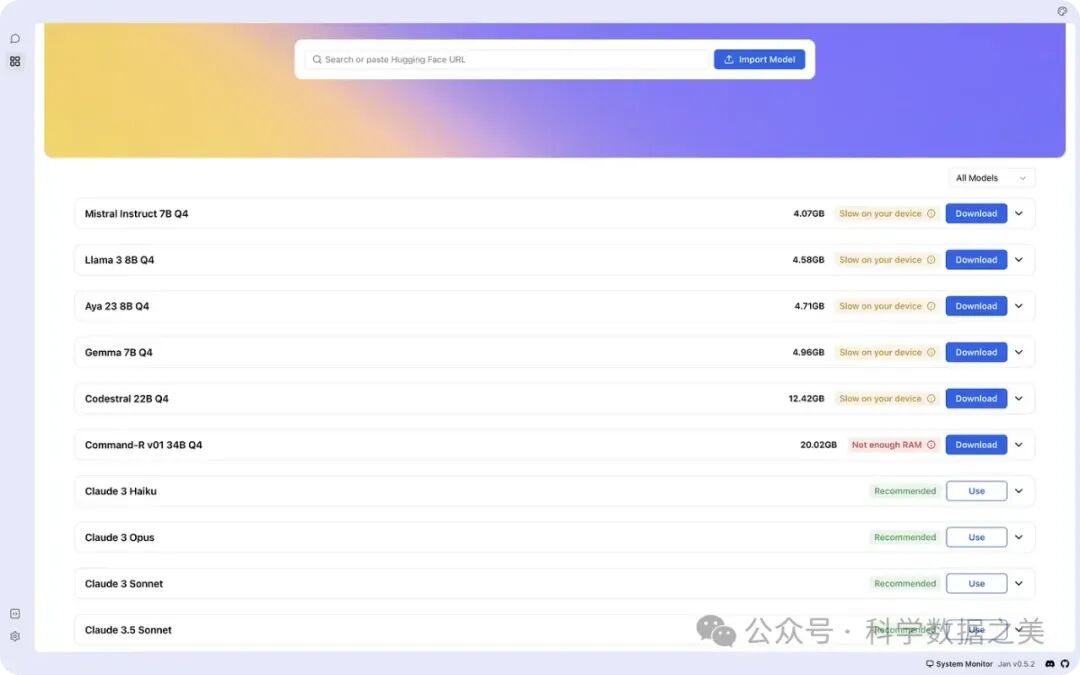

2. Jan

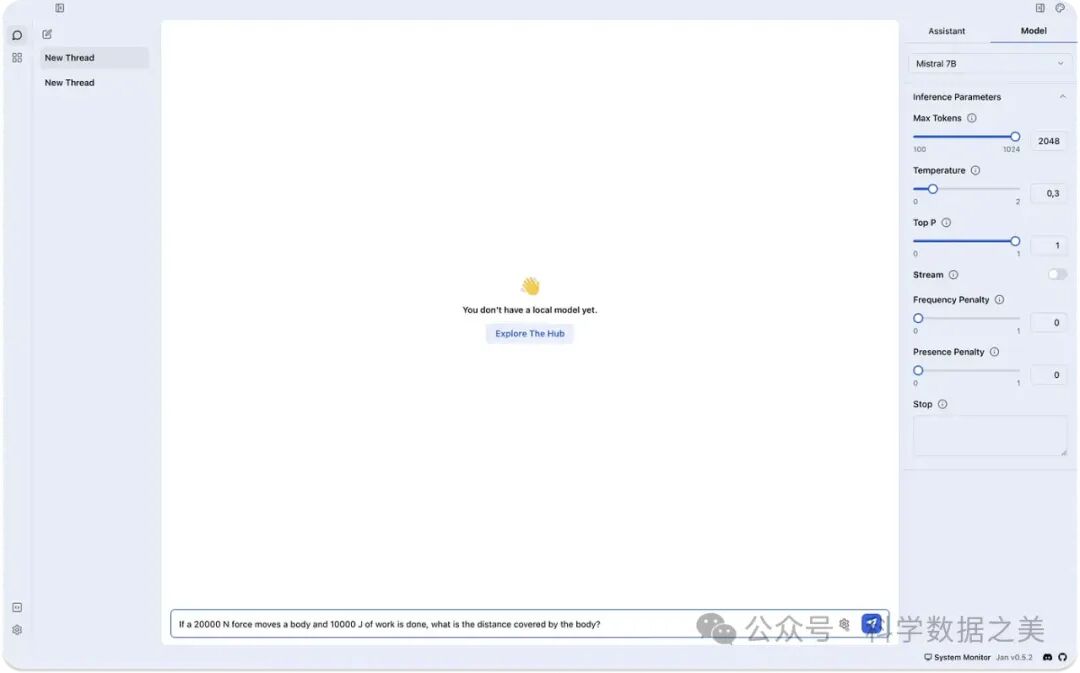

Jan被称为开源离线版的ChatGPT,支持在本地设备离线安装运行流行的70多个大语言模型,支持从Hugging Face等来源导入模型,支持TensortRT和Inference Nitro等扩展,以自定义和增强用户的AI模型,支持自定义推理参数。

下载地址:https://jan.ai

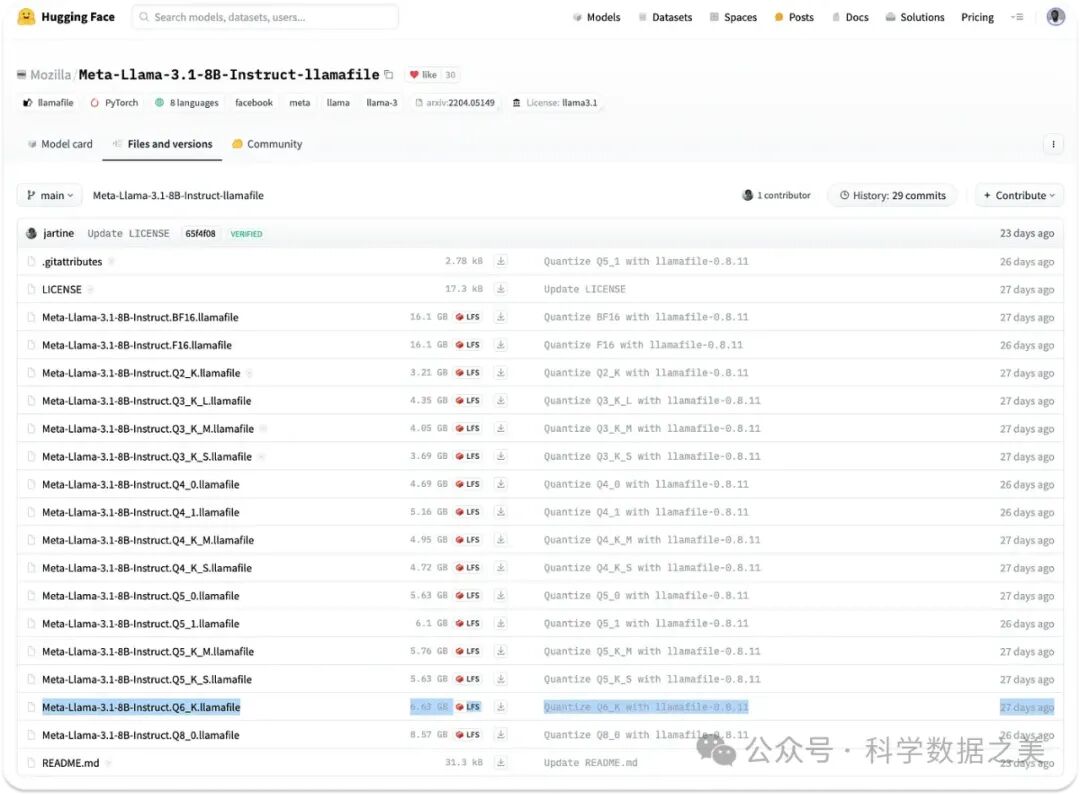

- LlamafileLlamafile能够将大语言模型转换为多平台支持的可执行链接格式(ELF),允许用户仅使用一个可执行文件运行LLMs。该工具支持在Windows、MacOS、Linux、Intel、ARM、FreeBSD等架构上运行,无需安装。在底层,Llamafile使用tinyBLAST在Windows等操作系统上运行,而无需SDK。

- 可执行文件:与LM Studio和Jan等其他LLM工具不同,Llamafile只需一个可执行文件即可运行LLMs。

- 使用现有模型:Llamafile支持使用现有模型工具,如Ollama和LM Studio。

- 访问或创建模型:您可以访问来自OpenAI、Mistral、Groq等的流行LLMs。它还支持从头创建模型。

- 模型文件转换:您可以通过单个命令将许多流行LLMs的文件格式转换,例如,将

gguf转换为llamafile:llamafile-convert mistral-7b.gguf。

由于其更快的性能,它非常适合用于总结长文本和大型文档。它完全离线运行并保持私密,因此用户的数据不会共享给任何AI服务器或API。类似Hugging Face这样的机器学习社区支持Llamafile格式,使得搜索与Llamafile相关的模型变得容易。https://github.com/Mozilla-Ocho/llamafile

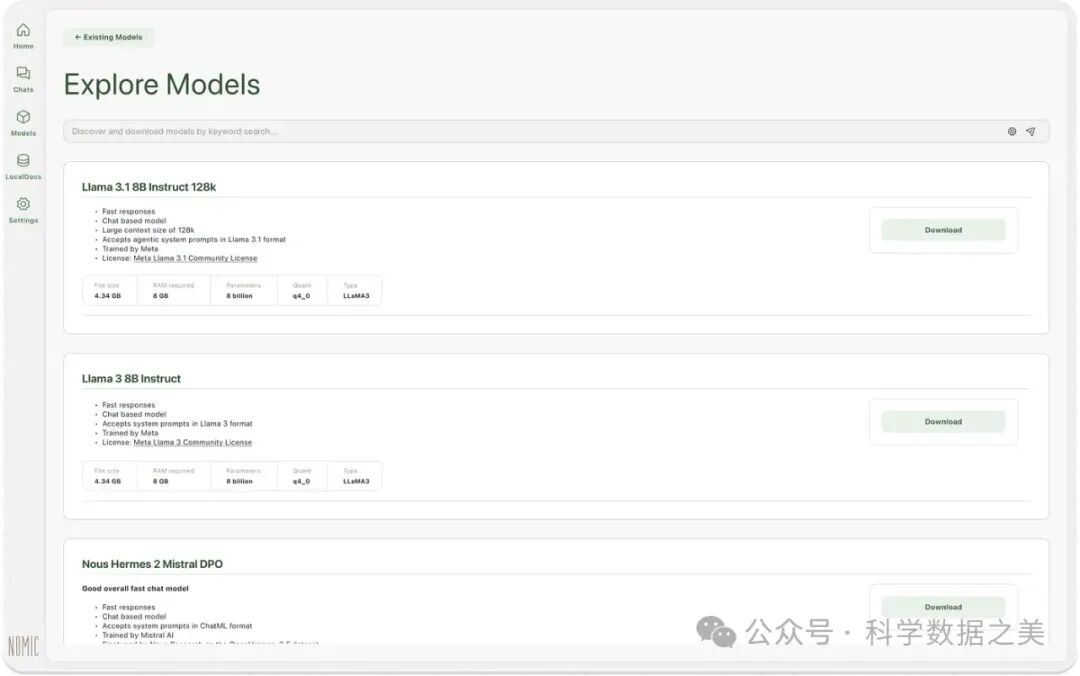

4. GPT4ALL

GPT4ALL是一个支持在个人PC或者笔记本电脑上运行大型语言模型(LLMs)的开源项目,无需调用API或者使用GPU,目前在github上已经获得了超过6.9万个星标。

https://github.com/nomic-ai/gpt4all

- Ollama

安装完成Ollam后,可以通过命令行运行模型,例如使用命令ollama run llama3来启动Llama 3模型。Ollama支持与Python等编程语言集成,用户可以通过LangChain等库与Ollama连接并使用其功能。用户可以轻松创建本地聊天机器人,而无需连接到像OpenAI这样的API。Ollama支持从PyTorch导入模型。Ollama支持转换.gguf模型文件并运行该模型。下载地址:https://ollama.com

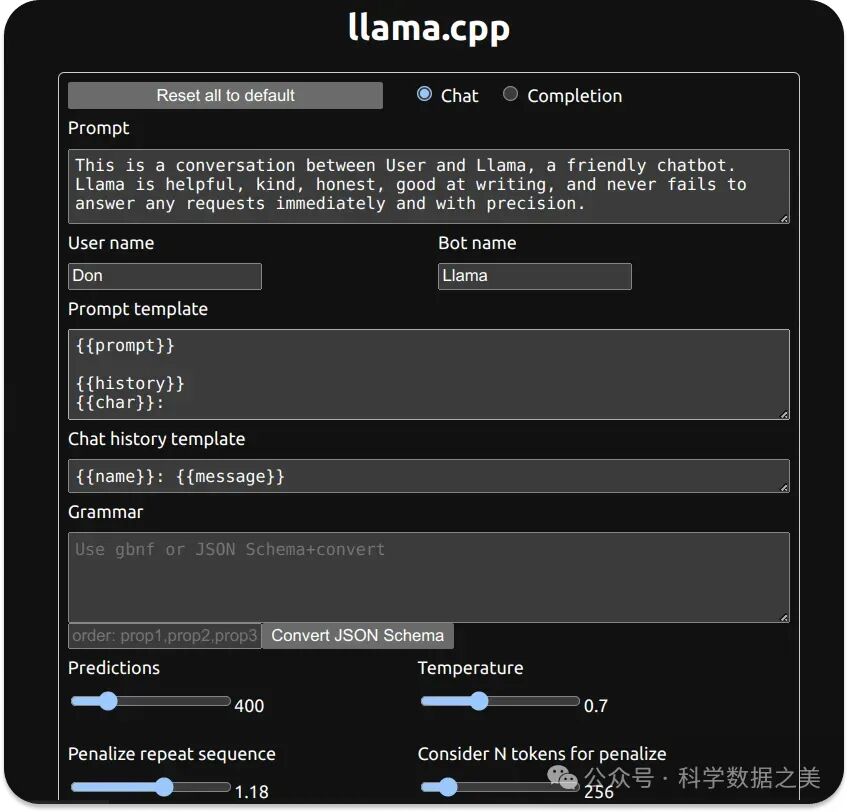

- LLaMa.cpp

LLaMa.cpp是支持Ollama等本地LLM工具的基础后端技术(推理引擎)。LLaMa.cpp能够以最小的配置在各种硬件上实现显著的大型语言模型推理,并提供出色的本地性能。它也可以在云中运行。它支持流行的主要LLM,如Mistral 7B、Mixtral MoE、DBRX、Falcon以及其他许多模型。LLaMa.cpp支持开源LLM用户界面工具,如MindWorkAI/AI-Studio(FSL-1.1-MIT)、iohub/collama等。

https://github.com/ggerganov/llama.cpp

本公众号相关内容推荐

- WebGIS技术栈推荐

- 使用Python工具可视化大型图网络

- 使用NetworkX提取图网络特征

- Argo海洋观测数据处理分析python库:ArgoPy

- 在Jupyter环境中创建交互式可视化地图

- 处理和可视化地理空间数据的Python库:EarthPy

- 地理空间深度学习python库:TorchGeo

- 遥感数据分析python库scikit-eo

- 图网络的应用场景及图分析python库

- 使用Python和NetworkX创建并可视化图网络(Graph Network)

- OpenResearcher:一个开源科学研究AI助理

- NeuralGCM: 一种融合机器学习与物理原理来模拟地球大气的新方法

- Transformer Explainer:文本生成模型交互式可视化工具

- 用于探索性数据分析(EDA)的开源python库

- 分享一个构建交互式D3js可视化的Python库

- 推荐15个图网络可视化python软件包

- 9个提升科研效率的软件工具

- 生成式人工智能模型颠覆传统天气预报

- 分享5个python可视化图表工具

- 分享17个网络(Network)数据可视化工具

- Napari:一个支持分析大型多维图像数据集的python工具

- 地理空间数据分析可视化R软件包汇总

- 大气海洋科学数据可视化案例集#2

- 一个快速检索和下载NASA地球科学数据的Python软件包

- 可视化呈现海洋洋流-墨西哥湾流

- 探索NOAA提供的数据产品资源

- 全球海洋船舶定位数据交互式可视化(附数据)

- 地球科学领域开源python包#1

- 地球科学领域开源python包#2

- 大规模空间矢量数据可视化Python库-lonboard

- 可视化呈现2023年是有气象记录以来最热的一年

- 大气海洋科学数据可视化案例集#1

- 地球科学领域计算分析开源Julia软件包

- 地球观测数据可视化工具

- 地球科学领域计算分析开源Julia软件包